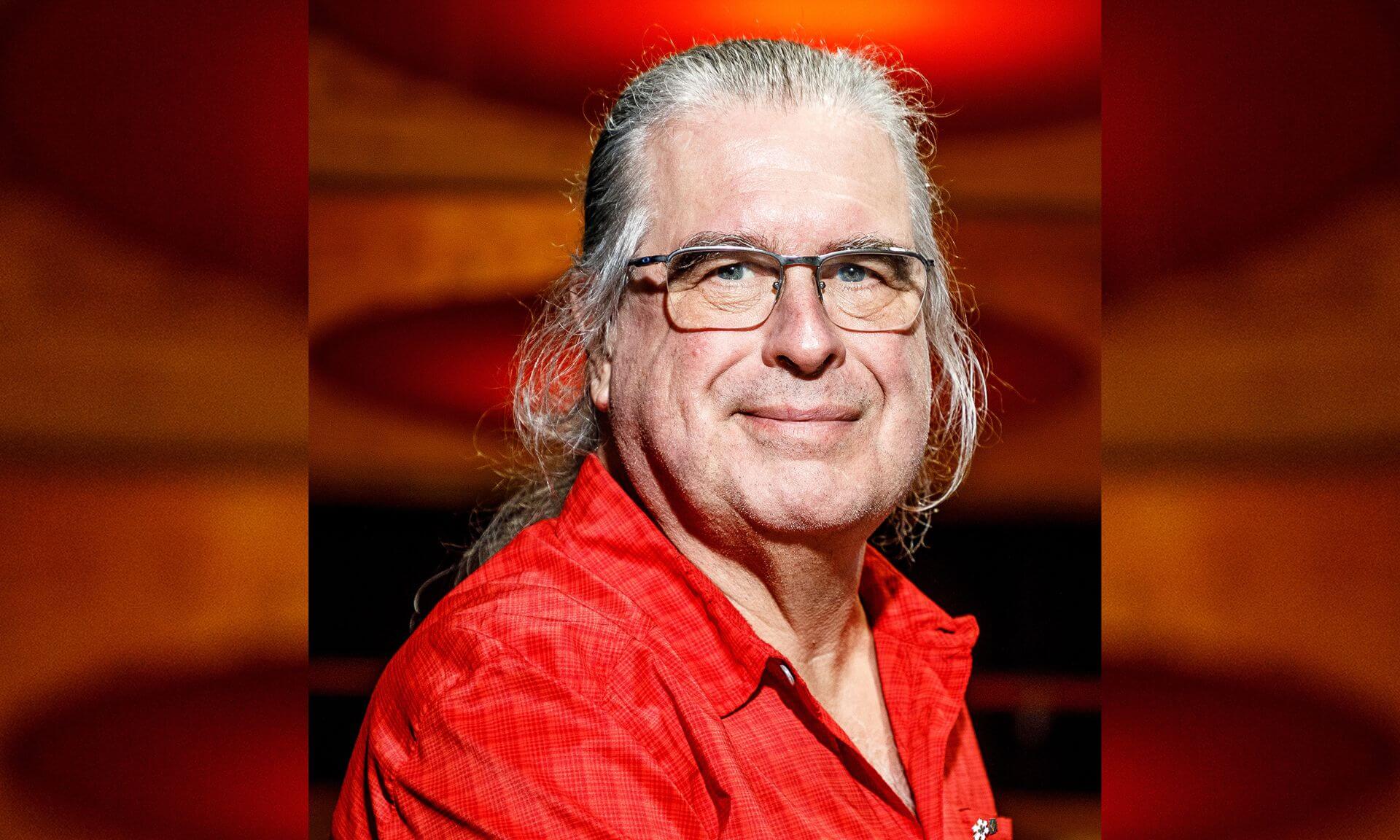

Cryptographe, universitaire et blogueur, Bruce Schneier est une figure reconnue à l’échelle internationale dans les domaines de la sécurité informatique et de l’intelligence artificielle (IA). Il sera de passage à l’Université de Montréal, où il donnera une conférence publique gratuite.

Bruce Schneier est chercheur associé au Berkman Klein Center for Internet & Society de l’Université Harvard et collaborateur d’Inrupt, une entreprise technologique cofondée par Tim Berners-Lee, l’inventeur du World Wide Web. Âgé de 63 ans, il est l’auteur de 14 ouvrages, dont le succès de librairie A Hacker’s Mind.

La conférence aura lieu le 29 janvier à l’auditorium du campus MIL et sera également diffusée en direct sur Zoom. L’inscription est obligatoire.

Intitulée «The coming AI hackers», elle portera sur les nouvelles formes de vulnérabilités que l’intelligence artificielle pourrait exploiter au sein de nos sociétés.

La conférence, donnée en anglais avec interprétation simultanée en français, est organisée par le Centre international de criminologie comparée de l’UdeM, en collaboration avec le Centre de recherche en droit public et la Chaire L. R. Wilson.

À la veille de son passage à Montréal, Bruce Schneier nous a fait part de quelques réflexions sur les sujets qu’il abordera.